国内创业公司DeepSeek发布大模型R1,性能媲美OpenAI o1

时间:2025-01-21 16:00

小编:小世评选

近期,国内人工智能领域迎来了一二波激动人心的消息。继月之暗面推出多模态思考模型K1.5之后,另一家创业公司DeepSeek于昨晚也正式发布了其最新的大模型DeepSeek-R1。这一新模型在数学、代码和自然语言推理任务上展现出与OpenAI的o1正版相媲美的性能,引起了广泛关注和讨论。

DeepSeek-R1的发布实际上是在去年的DeepSeek-V3开源之后的一次重要飞跃。DeepSeek-V3因其在各类挑战性任务中取得的意想不到的成果,引发了较大的热潮。这次的新模型R1则以更为强大的能力震惊了许多AI研究者,激发了业界对其技术背后的好奇与讨论。

根据AutoAWQ项目的作者Casper Hansen的解析,DeepSeek-R1大大依赖于一种创新的训练方式——多阶段循环训练。其过程顺序为基础模型→ 强化学习(RL) →微调 → RL →微调 → RL。这种训练机制不仅提升了模型的总体性能,也确保了模型在多种任务中的适应能力。

加利福尼亚大学伯克利分校的教授Alex Dimakis对R1模型作出了高度的评价,认为其在推理、语言理解以及对复杂问题的解析上均表现突出。目前,DeepSeek-R1已在其官网、应用端及API端全面上线,用户只需访问https://www.deepseek/便可直接体验该模型的魅力。

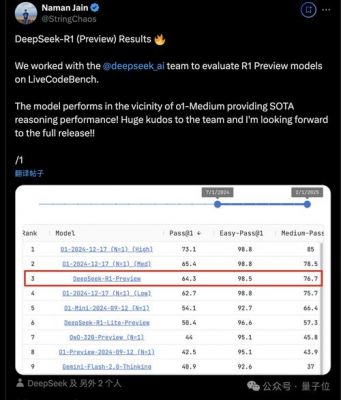

在技术方面,DeepSeek-R1采取了极具创新意义的大规模强化学习(RL)手段,在训练过程中极少依赖标注数据,却能有效提升模型推理的能力。这一策略使得DeepSeek-R1在多个数据库上与OpenAI的o1-1217和自家的DeepSeek-V3模型展开了比较。结果显示,DeepSeek-R1在多个测试中表现出色,双方的优劣势相互转化,形成你追我赶的局面。

更令人兴奋的是,DeepSeek不仅推出了DeepSeek-R1,还同时开源了包含660B参数的DeepSeek-R1-Zero,并允许用户基于该模型进行更深层次的训练。DeepSeek-R1从多个维度进行性能蒸馏,生成了六个小模型,这些小模型的参数分别为1.5B、7B、8B、14B、32B和70B,目的是为了回馈开源社区,推动“开放AI”的发展。

从性能比较来看,R1的32B和70B版本远超了GPT-4o、Claude 3.5 Sonnet和QwQ-32B,并且在性能上逐渐逼近o1-mini。而DeepSeek-R1的API服务价格也非常有竞争力,开发者每百万个输入tokens仅需支付1元(缓存命中)或4元(缓存未命中),而每百万个输出tokens仅需16元。这与OpenAI的高昂定价形成鲜明的对比,极大的降低了开发者的使用门槛。

深耕开源领域的DeepSeek团队并没有因为取得的成绩而止步不前,他们选择将R1模型的训练过程及其相关技术全部公开,力求推进更多的研究与应用创新。其发布的论文对此进行了详细的阐述,相关链接为https://github/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf。

在研究方法上,DeepSeek团队的创新值得关注。不同于以往主要依靠大量监督数据来提升模型性能的做法,DeepSeek团队提出了在少量冷启动数据的辅助下,通过GRPO(Group Reward Policy Optimization)设计来降低训练成本的方式。GRPO这样设计不仅消除了对与策略模型相同大小评估模型的需求,更加高效。冷启动数据的引入对于提升模型的稳定性也起到了显著效果,通过精心设计的模式,DeepSeek-R1相比DeepSeek-R1-Zero在用户体验方面表现出更好的性能。

当前模型的构建中加入了语言一致性奖励设计,以缓解多语言混合的困扰,并充分考虑了用户的偏好,在生成内容时保持一定的可读性和规范性。

,DeepSeek团队在推动模型不断自我进化的过程中,还通过拒绝采样与监督微调等方式,实现了全场景的强化学习。这使得最终训练出来的DeepSeek-R1模型,能够在推理能力、语言输出等方面展现出色的性能。

DeepSeek-R1的推出不仅让我们看到了国内创业公司在人工智能领域的迅速崛起,也为追赶包括OpenAI在内的国际大厂带来了强劲的动力。这一模型的发布必将引起更多行业内外的关注与探索,激发更广泛的技术创新浪潮。