大型语言模型推动端侧AI技术迅猛发展,市场规模预计十年内增长近十倍

时间:2025-02-23 12:50

小编:小世评选

近年来,人工智能技术的快速发展势头推动了大型语言模型(LLMs)在自然语言处理(NLP)领域的显著突破。这些模型,如OpenAI的GPT系列和Meta的LLaMA系列,自2017年Transformer架构问世以来,逐渐成为行业的领导者。尽管传统上这些模型主要运行于云端服务器,提供了强大的计算能力,却也伴随着网络延迟、数据安全和持续连接等一系列问题。这些瓶颈在一定程度上制约了LLMs的应用推广,影响了用户的体验。因此,将LLMs部署于端侧设备的探索成为了一种必然的趋势。

端侧AI的兴起不仅为用户带来了更快的响应能力,也更好地保护了用户隐私,实现了个性化的使用体验。根据市场研究,全球端侧AI市场规模预计从2022年的152亿美元快速增长至2032年的1436亿美元,这一接近十倍的增幅不仅反映了市场对边缘AI解决方案的迫切需求,更强调了该技术在制造业、汽车产业、消费品等各个领域的重要性。

存算一体技术的演进

存算一体技术的成熟为端侧AI大模型的商业化提供了有力的技术支撑。这项新兴的计算架构结合了存储与计算的功能,能够极大地提升计算效率。存算一体的核心在于将计算能力嵌入存储器中,从而减小数据处理的传输延迟,克服冯·诺依曼架构的性能限制。根据功能实现的不同,存算一体可细分为近存计算(PNM)、存内处理(PIM)以及存内计算(CIM)三种技术。

近存计算是通过将计算单元与内存单元相对接近来减少数据传输路径,使得访存带宽和效率明显提升,尤其适用于需要大规模并行处理的应用;

存内处理则通过将计算模块嵌入存储芯片中,使得存储设备本身具备计算能力,此技术特别适合数据密集型任务,能显著提升处理效率;

存内计算则把存储与计算单元深度融合,直接实现数据处理,会显著降低数据访存延迟,提高整体计算效率。

这些技術正在为端侧AI大模型的落地提供更加多样化的选择,企业可根据具体应用需求及性能目标做出合理决策。

NPU在端侧大模型中的应用

神经网络处理器(NPU)在智能手机SoC中的早期使用已经改善了用户的日常体验,提升了影像和音频处理能力。伴随生成式AI用例的增加,垂直领域的多样化需求使得传统CPU和GPU面临了新的挑战。一方面,它们在功耗和散热能力受限的条件下难以满足日益复杂的计算需求;另一方面,随着用例的不断演变,固定功能的硬件部署已经显得逐渐不切实际。

为了解决这些问题,异构计算架构日渐受到重视。这种架构能有效应对AI应用的多样化需求,包括定制设计的NPU,以及结合了CPU和GPU特色的处理器。不同的处理器在算法处理上各有优势,CPU擅长处理流程控制,GPU在并行数据处理上表现亮眼,NPU则在处理标量、向量及张量这种特定运算上出色。通过采用异构计算的方式,企业可以实现更高效的运算性能、优越的能效和持续的电池续航。

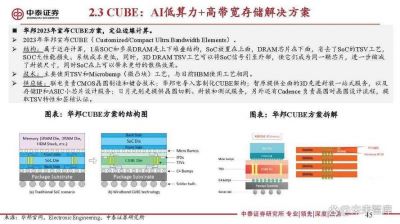

先进封装技术的推动力

异构计算架构的实现必然需要依托于先进的封装技术。这些先进的技术通过将不同功能的芯片(如CPU、GPU、FPGA、DSP等)集成在一起,构建起高性能、高能效及多功能的计算系统。通常,先进封装可细分为基于XY平面延伸的技术与基于Z轴延伸的技术。前者主要通过重新分布布线(RDL)进行信号延伸与互连;而后者则利用通孔互连技术(TSV)实现更多层次的信号连接。

随着端侧AI市场的繁荣,相关的技术也在不断地进步和迭代。未来的十年,将会见证更多基于大模型的应用在各个行业中的广泛推广及深化。因此,业界对于LLMs的探索、存算一体技术的完善以及异构计算方案的推进,都将为端侧AI的商业化落地奠定坚实的基础,助力这个快速发展的市场实现预期的十倍增长。