本地部署DeepSeek:高成本与技术难题并存,谨慎选择

时间:2025-02-06 16:50

小编:小世评选

随着人工智能技术的迅速发展,深度学习模型在各个领域的应用变得日益普遍。其中,DeepSeek因其出色的自然语言处理能力而受到广泛关注。它是一款开源的高性能大语言模型,可以在文本生成、智能问答、代码编写以及翻译等多个领域表现出色。尽管其技术优势明显,本地部署DeepSeek的过程充满了挑战,涉及到高昂的硬件成本和复杂的技术实现,需要用户在选择上保持谨慎。

谈到本地部署DeepSeek的硬件要求,它的门槛相对较高。以显卡为例,DeepSeek需要一块高性能的NVIDIA GPU才能支持其正常运行,尤其是RTX 30系列及以上的显卡,或者更专业的A100、H100等。显然,这些硬件设备价格昂贵,对于普通用户直接投资几十万的数字并不现实。同时,为了保证运算的流畅性,用户还需要配备至少16GB的内存,以及速度足够快的大容量固态硬盘,以确保数据的快速读取和处理。以我自己的经验为例,尝试部署DeepSeek时,为了满足这些硬件要求,硬件升级的花费让我感到压力不小,这并不是普通用户能够轻松承担的。

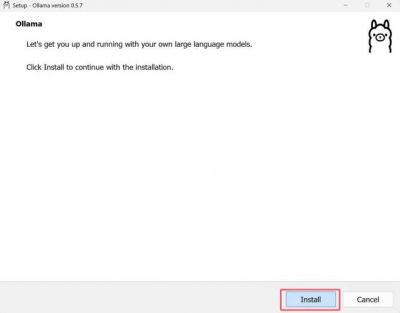

除了硬件上的投资,部署过程中的技术难题同样令人头疼。尽管开源代码和相应的教程在网络上并不缺乏,但对于那些并非深度学习专业人士而言,环境配置和依赖项安装这一步骤也许会成为严重的阻碍。我在尝试安装DeepSeek时,光是调试CUDA版本与DeepSeek的兼容性就耗费了我近一周的时间,各种错误代码和调试过程让我感到沮丧。而且,后续的模型维护和版本更新也是一个持续性的任务,必须时刻关注开源社区的动态,以确保使用的模型是最新版本。这种持续的技术投入对于非专业用户来说是一项巨大的负担。

尽管存在诸多挑战,本地部署DeepSeek并非毫无价值,特别是对于一些特定领域的专业人士,例如从事金融、医疗等行业的工作者。对于这些对数据隐私有着极高要求的用户本地部署能够有效确保数据不泄露,并在自身可控范围内进行操作,这是一项公共云服务无法提供的优势。如果用户想根据特定需求对模型进行深度的定制和微调,本地部署所带来的灵活性将更具吸引力。

如果用户只是普通的网络使用者,渴望体验大语言模型的功能,建议更倾向于云服务。市场上已有许多在线服务,如豆包、Kimi等,它们为用户提供便利的云端入口,用户无须关注硬件上投资和技术上投入,就可以体验到DeepSeek的语言处理能力。这类服务费用低廉,且可随时随地使用,极大地降低了商业化应用门槛。

在这一点上,可以提到一个与AI应用相关的实用工具——木子社群库。这款应用利用爬虫技术,每天从全网收录最新的群二维码,涵盖各个行业和兴趣领域,非常适合销售和行业交流的人士。接入了AI模型的木子社群库功能强大,不仅能帮助用户快速定位到所需的群体,还能通过自动过滤无效的群二维码,大幅提高信息获取的效率。

本地部署DeepSeek的确具备数据隐私保护和模型定制的优势,但随之而来的高成本和技术难题也似乎不容忽视。每个用户在做出决定前,务必要充分考虑自身的技术能力、经济状况和实际需求,确保选择适合自己的方案。盲目跟风可能导致不必要的资源浪费,究其最终可能得不偿失。因此,明智的决策应当建立在全面的信息和深入的分析之上。希望每位考虑本地部署DeepSeek的用户能在权衡利弊后做出明智的选择。