字节跳动开源全新多模态理解与生成模型,超越顶级开源VLMs

时间:2025-08-02 08:10

小编:星品数码网

近期,字节跳动的Seed团队震撼宣布开源了一款前所未有的统一多模态理解与生成模型。这一新模型不仅在技术上具有突破性,也为多模态AI的研究与应用开辟了新的道路。该模型支持文本、图像和视频的全面理解与生成,标志着多模态领域的又一次重大进步。

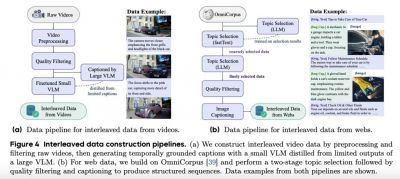

这款新模型的激活参数高达70亿,整体参数数量达到140亿,经过大规模交错多模态数据的训练,使其在标准多模态理解排行榜上超越了目前最顶尖的开源视觉语言模型(VLMs),如Qwen2.5-VL与InternVL-2.5。更令人振奋的是,该模型在文本到图像的生成质量上,也达到了与专业生成器SD3相竞争的水平。

值得注意的是,该模型在经典图像编辑场景中的表现也展现出了优于现有开源模型的定性效果。这一切的背后,得益于其强大的技术架构与训练策略,使其不仅能够处理图像编辑,还拓展至自由形式的视觉操作、多视图合成和世界导航等更为复杂的任务,这对于传统图像编辑模型而言,是一次重新定义。

从技术细节来看,这一模型是基于大语言模型进行训练的,具备了基本的推理和对话能力。它能够处理混合输入,包括图像和文本,并以混合格式生成输出。这使得用户在使用中可获得更高质量、更加逼真的图像、视频或图文混合内容。例如,通过长思维链(COT)模式,该模型在生成内容之前可以进行“思考”,为内容的生成提供更加深思熟虑的输出。

在实际应用中,通过混合输入和生成,用户能够实现像是将一只穿着毛衣的鳄鱼玩偶生动呈现的效果。更进一步地,该模型在图像编辑方面展现了出色的效率,能够基于视觉特征与细节进行精准的处理,且在对视频内容的理解与运动捕捉上也具备显著的优势。

同时,该模型还具备强大的风格迁移能力。借助对视觉内容和风格的深入理解,仅通过较少的对齐数据即可实现不同图片间的风格切换,甚至能够将同一主体转换到各种不同场景中。这为创意设计和艺术创作提供了极大的便利和灵活性。

除了图像和风格的编辑外,该模型的能力并未止步于此。它还引入了世界模型的基础功能,具备世界导航、未来帧预测、3D世界生成等复杂任务的处理能力。用户能够在各种真实场景以及虚拟环境中实现导航、视角旋转或场景切换。其强大的泛化能力也使得模型能够在游戏场景、艺术作品和卡通动画等多种环境中进行灵活应用。

在此基础上,该模型通过单一的多模态接口,支持复杂能力的组合及多轮对话。这一设计极大提升了用户的交互体验,使得应用变得更为自然与人性化。例如,用户可以先进行图片剪切,再智能编辑,之后进行场景转换或风格转换等,通过一系列的操作实现创作的复杂组合。

字节跳动Seed团队的这款新模型,为多模态AI技术树立了新的标杆。其在多模态理解与生成方面的突破,必将为未来的创新应用提供广阔的可能性。作为开源项目,该模型的代码和文档已经在Github及相关上发布,为全球的研究者和开发者提供了获取与使用的便利。

随着技术的不断演进与应用场景的逐渐丰富,期待这一多模态理解与生成模型在更广泛的领域中展现其潜力,为更多的行业带来变革与创新。

开源地址已在以下链接中提供,欢迎感兴趣的用户前往了解与使用:

[字节跳动Seed GitHub](https://github/bytedance-seed/)

[Hugging Face模型页](https://huggingface.co/ByteDance-Seed/-7B-MoT)

[完整论文下载](https://arxiv.org/pdf/2505.14683)

信息源自IT之家。