阿里开源万相2.1模型,视频生成领域再创佳绩

时间:2025-03-04 23:53

小编:小世评选

近日,阿里巴巴宣布开源其最新的生成基座模型万相2.1(Wan),这一消息引发了业内的广泛关注与讨论。在最新的评测中,万相2.1模型超越了Sora和Luma等其他主流视频生成模型,成功跻身榜首。此次开源不仅是阿里云在技术创新上的重要一步,也标志着视频生成技术的进一步发展,为更多开发者和企业打开了新的机遇。

万相2.1模型概述

万相2.1包含两个不同参数规模的模型,分别是140亿参数和13亿参数。140亿参数的模型设计旨在满足高端专业人士对生成效果的严格要求,而13亿参数的模型则在生成速度上表现出色,兼容所有的消费级GPU,使得其在应用层面具有更大的灵活性和普及性。阿里云同时开源了两个模型的全部推理代码和权重,开发者可以低成本地访问并应用这一底层技术。

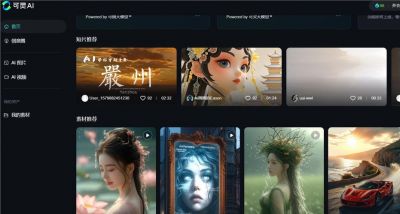

万相2.1在视频生成能力上的突破主要得益于其自研的高效VAE(变分自编码器)和DiT(数据驱动图网络)架构,这大大增强了模型对时空上下文的理解能力。利用这些先进的技术,万相2.1可以高效地编解码无限长的1080P视频,同时首次实现了中文文字视频生成的功能。这使得用户不仅可以创建视频,还可以进行视频编辑,图像生成,以及生成与视频相关的音频内容,从而满足多样化的内容创作需求。

值得一提的是,万相2.1还支持中英文视频生成,用户可以通过一键生成艺术字体,丰富视频的视觉表现力。该模型还提供多种视频特效选项,如渐变过渡、粒子效果和虚拟模拟等,提升了作品的观赏性和艺术效果。

开放共享的未来

分析人士指出,万相2.1的开源不仅代表了阿里云在全模态、全尺寸视频生成模型上的领军地位,也为更多开发者提供了低成本获取优质AI技术的机会。通过这一开放共享的方式,开发者能够利用万相2.1的强大功能开展与自身业务和需求相关的各类视频生成应用,助推产业创新。

近年来,全球范围内的开源趋势逐渐成为大模型领域的标配。自2025年以来,国内外多家企业纷纷推出各自的开源模型。字节跳动的豆包、百度的文心一言等相继涌现,形成了一股新的开源热潮。在这一过程中,阿里万相2.1的全面开源释放的产业红利不仅对其竞品如OpenAI、谷歌等公司带来挑战,同样为AI领域的竞争格局带来了变革。

例如,谷歌的新一代Veo 2模型近期披露的定价显示,每生成1秒视频需要付费0.5美元,这意味着生成一个小时的视频将需要高达1800美元的费用。万相2.1的开源则极大降低了视频生成的成本,为广大开发者和企业创造了更为广阔的市场空间。

多模态视频生成的应用场景

在视频生成技术的生态中,微美全息也在积极布局。该公司在AI视频生成领域的多模态能力发展迅速,涵盖了大语言模型和视觉生成模型。面对万相2.1的开源和市场竞争,微美全息正逐步实现全模态、全尺寸的开源,更好地服务于各类场景需求,如文本生成视频、图像生成视频等。这些发展将使得短视频生成、剧情创作等应用场景不断扩大。

微美全息专注于AIGC(生成式AI)的研发,其技术核心在于通过结合大规模预训练和优化的多模态算法,提升生成内容的连贯性和物理合理性。这些努力将为其在未来提供强大的技术支持,让行业生态的各个方面都能受益于AI技术的不断迭代与升级。

未来的AI视频生成领域已然站上了一个新的起点。阿里万相2.1的开源,不仅意味着技术能力的提升,也预示着商业化应用的加速落地。机构普遍认为,这一举措将带动车载算力、云计算及内容创作等各个环节的生态升级。

可以说,AI的下半场不再仅仅是技术竞争的较量,更是关于资源、效率与成本的综合博弈。这场新的革命正在加速推进,值得业界共同关注与探索。