DeepSeek-R1:利用GRPO算法提升推理能力和训练效率

时间:2025-02-14 07:10

小编:星品数码网

随着人工智能的迅猛发展,语言模型在各种复杂任务中取得了显著的成就。在这一背景下,DeepSeek-R1模型通过采用GRPO(Group Relative Policy Optimization)算法,有效提升了推理能力和训练效率,为大规模语言模型的优化开辟了新的路径。本文将深入分析这一技术的训练流程、实现机制及其带来的显著性能提升。

在DeepSeek-R1的训练流程中,整个过程可以分为多个阶段,每个阶段都旨在提升模型生成效果和推理能力。监督微调(SFT)阶段是整个训练的基础,通过高质量标注数据对基础模型(如DeepSeek-V3)进行微调,提升模型在特定任务上的初步性能。这一阶段为后续的强化学习奠定了坚实的基础。

强化学习(RL)阶段中,GRPO算法发挥了核心作用。GRPO的独特之处在于组内奖励归一化和动态梯度正则化,从根本上简化了传统价值网络的需求。这使得训练效率和稳定性显著提高,更加适合大规模语言模型的训练。在这一阶段,模型专注于数学、编程等结构化任务,通过准确性奖励、格式奖励和语言一致性奖励等机制,优化决策过程,准确性提升显著。例如,在AIME 2024数学竞赛中,DeepSeek-R1模型的Pass@1得分从15.6%激增至71.0%,代码生成任务的可运行率则提升至85%。这样的改进,不仅证明了GRPO算法在推理能力上的强大优势,也展现了其在提高训练效率方面的潜力。

在进一步的拒绝采样(RS)阶段,DeepSeek-R1通过生成高质量的合成数据集(如60万推理样本和20万通用任务样本),扩展了模型的泛化能力,这为模型适应多样化的开放域任务打下了基础。在这一过程中,生成的候选指令被严格评估,并由训练过的奖励模型进行筛选,以确保最终用于SFT的数据质量。这一阶段在优化推理能力和拓宽任务适应性方面的贡献不可忽视,它有效减少了训练过程中的无效数据,提高了训练的效率。

在最终强化学习阶段,GRPO算法再次发挥重要作用,结合更加复杂的奖励模型(如基于结果的奖励和人类偏好模型),进一步优化了模型的有用性、无害性和社会适应性。通过多阶段的训练方法,DeepSeek-R1不仅在数学推理领域表现突出,其长上下文处理能力及推理路径优化也显著提升,最高胜率达92.3%,这在实际应用中具有深远的意义。

GRPO算法设计的核心在于优化策略,而其创新的实现机制相较于先前的PPO等传统方法具备独特优势。根据GRPO的工作原理,策略优化基于策略组的相对奖励,简化了优势计算,降低了内存占用需求。动态梯度正则化增强了训练时的稳定性,避免了模型在更新过程中出现的不稳定性,这随着多个波轮迭代的不断进行,使得模型不断自我进化其推理能力。

与其他算法相比,GRPO算法的优势显而易见。不仅计算营养更少、训练效率显著提升,其模型性能在处理复杂推理任务上表现出了更高的可接受性。在对比传统算法时,GRPO在没有严格依赖价值网络的情况下,依然能够达到甚至超越以往算法的性能目标。

DeepSeek-R1通过多阶段的训练过程,以及GRPO算法的应用,不断优化其策略和推理能力,展现了一种全新的强大的模型训练方式。未来,随着更深入的研究和实践,GRPO将在大规模语言模型的训练与应用中扮演更加重要的角色,推动人工智能技术的进一步发展与普及。

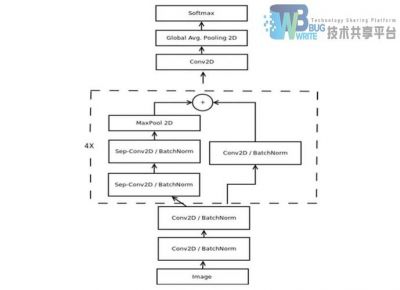

在中可以看到,DeepSeek-R1的实施效果证明了GRPO算法在强化学习中的巨大潜力,促使模型在计算效率、训练速度、推理能力等多个维度实现质的飞跃。通过本文的深入分析,不仅能了解到GRPO的具体实现和优化策略,更能对未来AI发展的方向有更清晰的展望。GRPO的崭新思路与方法论,将为激烈的竞争环境带来更多的创新可能。