中国新兴AI公司DeepSeek颠覆行业格局,低成本模型挑战OpenAI

时间:2025-02-06 22:10

小编:小世评选

在2025年初,全球人工智能(AI)领域迎来了一场前所未有的变革,一家成立仅三年的中国公司DeepSeek接连推出两款颇具影响力的模型,打破了行业的传统竞争格局。这家新兴公司不仅在性能方面与OpenAI的产品相媲美,其训练成本却仅为557万美元,相比OpenAI的GPT-4大幅降低,引发了广泛关注和讨论。

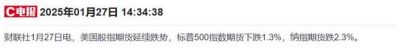

DeepSeek的崛起,震动了科技界,尤其是在硅谷,Nvidia的市值在此消息发布后单日蒸发了1200亿美元,美股的AI概念股全面下跌,显示出DeepSeek给行业带来的深远影响。更为引人注目的是,DeepSeek在AI模型训练上所展现出的高效和低成本,标志着整个AI训练领域的技术进步和成本结构的潜在重塑。

据DeepSeek公布的数据,其训练的模型总算力达到278.8万GPU小时,而这一数字相比OpenAI数十亿美元的投入显得极具竞争力。这表明,在AI训练过程中,尤其是在计算力和训练成本的优化上,DeepSeek展现了独特的优势。DeepSeek所采用的“H800”型号GPU,使其在算力调配上进行了极致的优化,而如果使用更为先进的“H100”GPU,DeepSeek可能会选择更大的训练集群。

DeepSeek的核心创新之一就是其训练模型“-Zero”。这款模型依靠纯强化学习(RL)进行训练,无需人工标注数据,从而有效降低了对外部资源的依赖。与AI行业目前普遍采用的封闭型数据训练方法不同,DeepSeek选择了开放模型权重和推理接口,迈出了与OpenAI策略截然不同的方向,这一决定可望引发AI研究方法的重大变革。

在分析DeepSeek的技术突破时,我们不能忽视其引入的两个重要创新:一是“专家混合模型”(MoE)技术,二是多头潜在注意力(multi-head latent attention)机制。MoE能够通过激活特定的“专家”网络,有效提高推理效率以及训练过程的资源利用率。而多头潜在注意力的应用则显著降低了模型对内存的需求,通过优化存储和计算过程,进一步压缩了训练成本。

根据DeepSeek的研究报告,训练一个模型所需的GPU小时数为278.8万,这其中包括11.9万GPU小时的上下文长度扩展和5000 GPU小时的后期训练。假设H800 GPU的租赁价格为每小时2美元,DeepSeek所需的训练成本仅为557万美元,令人难以置信地低。

DeepSeek模型的关键在于其独特的训练方法。传统的强化学习通常依赖于人类反馈(RLHF),但DeepSeek创造性地采用了自我进化的方式,让AI通过解决数学和逻辑问题逐渐学会推理能力。这一过程中,AI不仅能够自我优化自身的答案结构,还能在训练过程中自然地实现所谓的“顿悟时刻”,从而提高了其推理能力。

DeepSeek与OpenAI和其他竞争对手相比,显示出了更强的市场适应性和创新能力。在AI逐渐面对更广泛的市场需求、不同行业的应用背景下,DeepSeek的成功仿佛为其他企业提供了一种新的可能:不仅经济高效地推出了底层的AI技术,还在推动整个技术生态中实现了更高的开放性。

尽管DeepSeek在效率上领先,OpenAI依然在整体模型的复杂性和能力上占据一定的优势,尤其是在训练数据的丰富性及算力支持方面。未来,开源AI的流行趋势有可能加速DeepSeek等公司对OpenAI的挑战,同时推动整个行业向更加多元化和透明的方向发展。

对于全球科技产业而言,DeepSeek的出现不仅仅是一个新公司的崛起,更是对现有AI市场格局的深刻反思。通过将AI技术的训练成本降低,DeepSeek为更多创业公司和行业提供了进入的机会,有助于推动市场的多样性和创新。正如Thompson在其分析中提到的,AI的未来不仅仅线性地向前推进,而是通过诸如DeepSeek这样的公司,揭示了一个更为复杂、更富有活力的竞争环境。

在这种新的生态中,AI服务的普及化与成本降低将推进更多市场参与者的进入,带来应用场景的丰富与创新。不可避免的是,随着技术的不断演化,AI将变得越来越普及,最终实现几乎零成本的AI服务,重塑整个科技行业。在这一背景下,DeepSeek的成功不仅是中国AI公司在国际市场上的一次华丽亮相,更是一场关于未来AI发展方向的深刻思考。

DeepSeek通过其独特的技术创新和低成本模型的优势,正在重塑全球AI竞争的格局,为行业带来了新的机遇与挑战。未来,AI技术的发展将如何继续演化,我们拭目以待。