DeepSeek:AI圈国产新星,以超低成本挑战硅谷巨头

时间:2025-01-12 19:30

小编:小世评选

在全球人工智能(AI)领域,尤其是在大模型市场的竞争愈演愈烈之际,DeepSeek这一中国团队以其革命性的表现,为长期沉寂的大模型领域注入了新鲜活力。2025年初,DeepSeek的发展故事横空出世,成为“国产之光”,以其超低成本和令人惊讶的技术实力震撼了海内外的科技圈。

DeepSeek的V3开源模型自2024年12月发布以来,不仅在性能上超越了阿里自研的Qwen 2.5和Meta自研的Llama 3.1,更是能够与OpenAI的GPT-4和Anthropic的Claude 3.5竞争。令业界瞩目的是,DeepSeek的研发团队仅由不到150名成员组成,远逊于OpenAI的1200人和Anthropic的500人团队。如此小的团队却能达到如此高的技术水平,其秘密何在?

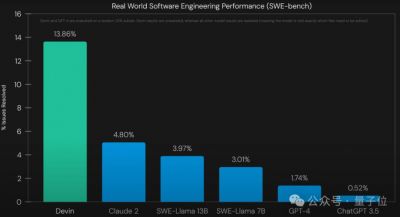

DeepSeek在算力资源上的独特策略为其提供了竞争优势。V3模型是在仅2000块低配英伟达H800 GPU上训练完成的,而其他硅谷大厂的模型训练通常需要几十万块高性能的英伟达H100 GPU。根据SemiAnalysis的数据显示,OpenAI GPT-4的训练成本高达6300万美元,而DeepSeek V3的成本不到其十分之一。这一技术创新突破了国产大模型一直受到的算力芯片限制,令许多技术难题迎刃而解。

DeepSeek的团队文化和人力资源结构同样是其成功的重要因素。创始人梁文锋在招聘时更看重年轻人的能力与潜力,而非经验。公司内充满了来自清华、北大等顶尖高校的年轻科研人员,他们在极具竞争性的环境中,通过参与高水平竞赛和研究,迅速成长为各自领域的专家。DeepSeek采取的扁平管理方式和“自下而上”的组织结构,允许团队成员自由地进行创新和探索。

DeepSeek的研发不仅聚焦于算力的降低,还在模型架构和算法上进行了深入的创新。其在V3模型中采用了FP8混合精度训练、模型压缩等技术,有效地减少了训练所需的计算需求。这些技术进展得到了多位业界专家的认可和赞誉。例如,OpenAI的创始团队成员Andrej Karpathy就曾推崇DeepSeek V3的表现,认为其无须依赖超大规模GPU集群,展示了未来大模型训练的新方向。

自DeepSeek进入市场以来,其市场定位也与主流的大模型公司大相径庭。DeepSeek并没有盲目追逐市场热点和融资机会,而是专注于底层技术的开发。其创始人明确表示公司在短期内没有融资计划,而是更关注高端芯片的短缺问题。这使得DeepSeek在面对竞争时保持了良好的灵活性和独立性。

在市场经济愈加竞争的背景下,DeepSeek的成功故事为国内的AI创业者提供了新启示。它不仅表明了第一类大模型能够以更低的成本及更少的资源取得良好的效果,也显示了在技术上不拘泥于现有标准,勇于探索新的方向的重要性。未来,DeepSeek还将继续拓展其技术边界和应用场景,为中国的AI事业贡献更多力量。

随着DeepSeek的崛起,中国在全球AI竞争中的地位正逐步提升。深度求索的故事激励着无数初创团队,向前探索不止,力求在AI的道路上开辟出宽广的新前景。在未来,随着科技的不断进步及市场需求的变化,DeepSeek的技术成果必将成为推动更大变革的重要力量。