研究揭示大模型与人类提问模式显著差异:AI偏爱长答案,直击事实

时间:2025-02-04 02:30

小编:星品数码网

近年来,伴随着人工智能技术的迅猛发展,最新的研究首次揭示了大模型与人类在提问方式上的显著差异。一个有趣的发现是,大模型傾向于生成较长的、需要详细解释的问题,而人类则更喜欢简洁且直接的问题。这一差异不仅影响了信息获取的方式,也对企业、考试题目设计等方面产生了深远的影响。

研究表明,在提问时,大模型与人类所遵循的思维模式截然不同。具体而言,大模型生成的许多问题需要较长的描述来解释,其中大约44%的问题属于这一类。这与其训练过程中接触到大量描述性文本密切相关。相对而言,人类提问者通常提出更为简洁且基于明确事实的问题,这些问题往往聚焦于具体的数据、事实核查或人物、地点、事件等的确认。

在具体的研究中,加州大学伯克利分校、沙特阿拉伯阿卜杜拉国王科技城(KACST)和华盛顿大学的研究团队对大模型的提问能力进行了系统评估。研究者们基于维基百科的文本,将内容拆分为86万个段落,并通过众包邀请人类参与者为每个段落撰写相应的题目及答案。这些人类生成的提问和答案将作为评估大模型的基准。

研究中使用了多项指标来评估提问质量,包括问题长度、上下文覆盖和答案可回答性等。研究发现,大模型提问出现了以下几个主要特点:

1. 问题类型的差异:大模型更倾向于生成需要较长且包含丰富细节的问题。相比之下,人类提问者更注重直接、快速获取的信息。这种趋势在各大模型中均表现明显,如闭源的GPT-4o和开源的LLaMA-3.1-70b-Instruct在问题生成中均显示出这一特征。

2. 问题长度的变化:大模型生成的问题在表达时更长,不同模型之间对此倾向的数据也有所不同。例如,GPT-4o生成的描述性问题往往表现出更长的单词数量。而人类提出的问题则在长度上显得更为简洁,且不同类型的问题长度差异较大。

3. 上下文覆盖能力的不同:人类在提问时能够更全面地借助上下文,包括句子级和词语级的分析,覆盖文本内容的范围更加广泛。相较之下,大模型的提问则倾向于关注文本的特定细节,尤其是文本的开头和部分,而对中间的信息关注较少。

4. 可回答性的变化:在依据上下文信息提出的问题中,大模型的问题通常具备较强的可回答性,尤其是在文本提供了清晰的背景信息时。在缺乏上下文的情况下,模型生成的问题可回答性明显下降,甚至会出现无法回答的情况。

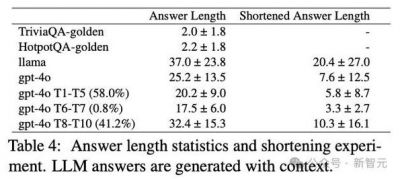

5. 答案长度的分析:研究进一步表明,大模型生成的问题通常需要更长的答案,涉及的细节量也明显高于人类生成的问题。尽管大模型生成的答案有压缩的可能性,但依然需要更长的文字来达到相似的解释质量。

鉴于这些区别,未来需要对大模型在面对更复杂文本时的提问能力进行更深入的研究。例如,针对包含多个段落或更长文本内容的文本,模型会如何生成问题及其相关的提问模式。

伴随着AI技术的不断进步,AI生成的问题在商业应用中愈加普遍,如亚马逊的购物助手推荐相关问题,或搜索引擎中使用后续问题帮助用户深入理解主题。认识到AI与人类提问者之间的独特差异,可以帮助我们在实际操作中测试和改进相关系统,甚至在设计交互中的问答环节时提供新的思路。

,了解大模型的提问模式差异,将有助于优化我们与AI的互动方式——无论是通过设计更好的提示语引导AI生成更符合我们需求的问题,还是理解大模型对信息处理的偏好,从而调整人类的思考方式,让人类学生在学习过程中更有效地吸收知识。同时,这种差异化的识别也可能对新一代学习者的认知模式产生潜移默化的影响。

这项研究为我们提供了关于AI提问能力的新视野,揭示了大模型与人类提问的显著差异,这在未来的教育、商业和科技创新中都将具有重要的启示和意义。我们应积极探索如何利用这些研究成果,推动人类与AI更好地协作与发展。